Еще один перевод статьи с BlueHatSeo. Думал, что этим постом будет четвертая часть SEO-империи, которую Эли проанонсировал в феврале, но на блоге ее пока нет. Так что давайте поговорим об индексировании сайтов. Я думаю, вам понравится 😉

(Перевод от первого лица.)

После того, как вы создадите сайт-хамелеон или отбеливатель ссылок, вам наверняка придется решить проблему его индексирования в поисковых системах. Возможно, вам еще не приходилось работать с большими сайтами, в которых больше 20k страниц, но, поверьте мне, проиндексировать их не так уж и сложно. Единственное, что я должен отметить, некоторые из приведенных ниже методов лучше всего подходят для сайтов с числом страниц от 20 до 200 тыс. страниц. Для сайтов, у которых больше или меньше страниц, нужно использовать немного иные методы.

Посещение сайта поисковыми ботами

Здесь нужно отметить два важных аспекта. Первый это структура сайта.

Вы должны так организовать сайт, чтобы максимально облегчить ботам работу по его индексированию. Для этого вы должны создать так называемые “узловые” страницы. Узловые страницы — это страницы со ссылками на внутренние страницы. Например, для сайта каталогов узловой страницей можно считать страницу, внизу которой стоит блок ссылок: “Pages 1, 2, 3, 4, …“. Единственная цель и ценность узловой страницы в том, что она помогает проиндексировать другие страницы сайта. Если вам нужно проиндексировать большой сайт, сначала проиндексируйте узловые страницы, и остальные страницы последуют за ними.

Второй важный фактор — количество посещений сайта поисковыми ботами.

Чем больше объем ботового трафика, тем быстрее проиндексируются страницы сайта. Хотя сам объем не играет большого значения: какой толк от того, что боты будут бомбардировать главную страницу сайта и не будут заходить на внутренние? Вы должны направить ботов, куда вам нужно, и здесь очень важна структура, о которой я рассказал выше.

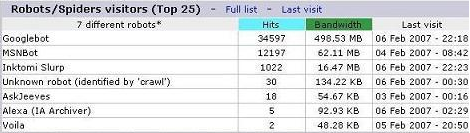

Это скриншот со статистикой одного из моих сайтов-хамелеонов, которому всего 10 дней от роду. Обратных ссылок на него совсем немного, однако это не помешало ботам за 6 дней проиндексировать 10k+ страниц.

Как я уже говорил, сделать это совсем не сложно. Для начала мы займемся базовыми вещами, затем перейдем к более продвинутым приемам и закончим тем, что я называю “сайтами-индексаторами”. Что из всего этого использовать, решать вам. Если вы не готовы применять тот или иной прием или у вас пока нет для этого достаточных знаний, остановитесь на более простых вариантах.

Внутренние ссылки на целевых страницах

Это самое простое, что можно придумать. Давайте вернемся к нашему сайту-хамелеону с партнерскими ссылками на сайта знакомств. Там каждая целевая страница представляет какой-то город. И на каждой странице есть (или можно поставить) ссылки на близлежащие города. (Для этого можно использовать выборку по ZIP-кодам или же вытягивать из базы записи, расположенные до и после ряда, которому соответствует указанный город.) Это позволит поисковым ботам переходить с одной целевой страницы на другую до тех пор, пока не проиндексируют все страницы сайта.

Обратная и/или вращающаяся карта сайта

Наверняка вы уже прикрутили простенькую карту сайта к своему сайту, и теперь она ссылается на все страницы ресурса. Говорят, поисковые боты относятся к картам сайта иначе, чем к другим страницам в плане количества ссылок, по которым они готовы перейти, но когда у вас есть 20k страниц и все их нужно проиндексировать, стандартная карта может оказаться малоэффективной.

Если мы отталкиваемся от того факта, что бот переходит только по определенному количеству ссылок с карты сайта, значит, нам нужно сделать так, чтобы он каким-то образом охватил все ссылки. Если у вас небольшой ресурс на 5k страниц, вам вряд ли придется об этом беспокоиться, но если у вас сайт-хамелеон на 30k+ адресов, стандартная карта сайта может оказаться бесполезной тратой времени. Дело в том, что ссылки с главной страницы ведут на внутренние страницы с низким порядковым номером в базе данных. Точно так же устроена и карта сайта — сначала она выдает первые ряды в базе, затем последние. В такой ситуации боты будут ходить по одним и тем же страницам.

Чтобы решить проблему, разверните карту сайта на 180 градусов. Для этого в базе данных замените ORDER BY ‘id’ на ORDER BY ‘id’ DESC (атрибут DESC подразумевает то, что последние страницы будут отображаться первыми, а первые — последними). Так страницы, которые, как правило, плетутся в хвосте карты, сразу привлекут на себя внимание ботов, и те их быстренько проиндексируют. Если с внутренней перелинковкой проблем нет, боты будут индексировать страницы с обеих сторон базы данных и со временем сойдутся в центре. В таком случае полная индексация сайта произойдет намного быстрее, чем если бы боты постепенно шли с первых страниц и до последних.

Еще лучше сделать вращающуюся карту сайта. Допустим, у вас есть 30k страниц. В течение первой недели расположение страниц на карте должно выглядеть так: 30,000-1. Затем вы берете первые 5k страниц и переносите их в конец карты. Теперь карта выглядит так: 25,000-1:30,000-25,001. В начале третьей недели вы снова прокручиваете карту и теперь она имеет вид: 20,000-1:30,30,000-20,001. И так до конца. Этот метод весьма эффективен.

Ссылки на внутренние страницы с других сайтов

Этот метод тоже позволяет существенно увеличить объем ботового трафика на внутренних страницах сайта. Благодаря ему вы сможете ткнуть ботов носом в те участки, которые они упорно не хотят индексировать. Чтобы операция прошла успешно, ставьте ссылки на узловые страницы. Ссылки могут быть идти как с ваших собственных, так и со сторонних ресурсов.

Сайты-индексаторы

Это самая эффективная тактика индексирования из всех, что я описал в этом посте. Сайт-индексатор — это специальный сайт, который вытягивает контент с других ваших сайтов, индексирует свои внутренние страницы и затем самообновляется — закрывает проиндексированные страницы и подхватывает другие, непроиндексированные. Создание такого сайта не займет много времени, однако для этого нужно разбираться в коде.

Сначала вам нужно создать главную страницу, которая будет ссылаться на 50-100 внутренних страниц. Каждая внутренняя страница будет наполняться контентом тех страниц из базы крупного сайта (например, сайта-хамелеона), которые вам нужно проиндексировать. Чтобы главную страницу сайта-индексатора не покидали поисковые боты, направьте на нее поток ссылочного веса с сайтов-отбеливателей ссылок.

После этого задайте команду cron, чтобы он ежедневно вытягивал из Google, Yahoo и MSN данные по запросу SITE:вашдомен.com. Создайте скрипт, который будет парсить результаты и сравнивать их со списком страниц на сайте-индексаторе. Как только страница будет проиндексирована во всех трех поисковиках, скрипт должен ставить на нее 301-й редирект, который будет вести на ее близнеца (целевую страницу с крупного сайта), и отмечать ее в базе данных как проиндексированную.

Теперь сайт-индексатор не будет обращать на нее внимание, и для создания новых внутренних станиц будет подхватывать только те страницы, которые еще не были проиндексированы каким-то (или всеми) из поисковиков. Такой сайт работает на автомате и в этом его настоящая ценность.

Сайт-индексатор будет трудиться до тех пор, пока все страницы крупного сайта не будут проиндексированы в основных поисковых системах. Этот метод работает настолько эффективно, что даже при полном отсутствии внешних ссылок на крупный сайт вы все равно сможете проиндексировать его внутренние страницы. Для этого вам понадобится всего несколько сайтов-индексаторов.

Записи по теме:

- Изучение обратных ссылок конкурентов

- Как создать серый сайт

- Захват ниши и топа поисковой выдачи

- Создание SEO-империи — Продолжение

Проиндексировать 20k страниц – это не проблема (в Google, MSN за 6 дней никогда не схавает столько, там явно очень сильные ссылки или вообще левая статистика), проблема их потом удержать в индексе, да и еще не попасть под всевозможные фильтры 🙂

Arser, наверняка Эли ставил ссылки со своих сайтов 🙂

Ведь толкать левую статистику ему нет никакого резона.

“Как только страница будет проиндексирована во всех трех поисковиках, скрипт должен ставить на нее 301-й редирект, который будет вести на ее близнеца (целевую страницу с крупного сайта)”

Не поясните, зачем убирать ссылку и ставить 301 редирект?

И ещё на близнеца с крупного сайта?

Александр, сайт-индексатор изначально создается для индексации страниц _именно_ крупного сайта. 301-й редирект как бы замещает проиндексированную страницу нужной страницей с крупного сайта. В результате замещения внутренняя страница с крупного сайта индексируется автоматом.

Идея классная, а где взять скрипт, который должен ставить 301-й редирект?

Dan, наверное, самому написать надо 🙂

Все так красиво и правильно написано 🙂

Только вот, если сделать так, как предлагает автор, то это гарантированный бан сайта в гугле. Если, конечно, у него трастовость не уровня adobe.com.

Вы сами посудите. Как видит снаружи гуглобот ситуацию?

появился сайт из ниоткуда, на который каждый день ссылки то появляются, то исчезают. Только гуглобот проиндексировал пачку страниц, как ссылки на них внешние пропали, но появились ссылки на другие страницы, только проиндексировал еще пачку, снова все изменилось.

Нет надежнее способа загнать под фильтры сайт, как устроить динамическую смену входящих ссылок. Если сегодня на сайт 1000 ссылок, а завтра эта тысяча пропала, по появилась другая, а послезавтра снова смена, и так пару недель, то сидеть сайту вашему в самом конце серпа, а то и вовсе быть выкинутым.

Кстати блог Эли ддосят, и говорят, что за материал по взлому phbb каптчи, который он разместил на сайте недавно. Мол, слишком много палит тем :).

Да, на блог не зайти, а темка мраком покрыта:

Результат поиска: страниц — 0

Искомая комбинация слов нигде не встречается.

«взлом phbb каптчи» · Запросов за месяц: взлом — 167 077, phbb — 128, каптчи — 523.

А что за скрин в посте приводится? Откуда данные об индексации поисковиками?

Написал я не правильно, вот как пост звучал:

User Contributed – Captcha Breaking W/ PHPBB2 Example

Robobee, точно, я только вот сейчас об этом прочитал.

Igor, нужно искать не “взлом phpbb каптчи”, а “phpbb captcha crack” или break или в этом духе 🙂

TYUS, на рисунке изображены объемы ботового трафика за указанный период.

Гугл по запросу site: выдаёт только 1 тысячу результатов. То есть после попадания в индекс первой тысячи страниц, таким способом не вычислить, что есть в индексе, а чего нету.

>Чтобы главную страницу сайта-индексатора не покидали поисковые боты, направьте на нее поток ссылочного веса с сайтов-отбеливателей ссылок.

По-моему, это темно-серый метод. Автор статьи хочет спалить сайты конкурентов, прочитавших его статью?

Статья впринципе не дает ничего нового! Только констатация факта! И то, про последний пункт сайт-индексатор, я бы поспорил!

Действительно, блог Эли не доступен. Выложил на своем блоге гостевой пост про опенсорс ломалку капчей для ПХПББ2.

Что касается сайта индексатора и бана от поисковиков. Эли ещё в первых статьях писал, что домен/сайт – это расходный материал. Пока гуглобот поймет, что его дурят и забанит индексатор, пройдет некоторое время и цель будет достигнута – хамелеон или отбеливатель в индексе.

Что касается бана или -950 для получателя – маловероятно, это внешние факторы.

А насколько этот сервис (http://blogsearch.google.com/ping) помогает индексированию сайта?