Почему страницы на сайте не индексируются или долго не хотят попадать в выдачу? Это извечная проблема, которую следует проанализировать. Далее – об основных моментах, препятствующих нормальной индексации.

Причины проблем с индексацией

№1. Робот не обращает на ваш сайт/страницу внимания. Это может происходить из-за разных факторов.

Особенно если ресурс молодой, может требоваться некоторое время, чтобы робот его увидел. В этом ему необходимо помочь: добавить сайт/страницу в аддурилки поисковых систем, поставить пару ссылок с других страниц, сайтов, соцсетей. Робот, гуляя по ссылкам, наткнётся и на ваш ресурс.

№2 Сайт добавлен в чёрный список

Возможно, у вашего домена плохая репутация. Вы или кто-то другой мог использовать методы «черного» SEO, за что на сайт были наложены санкции. Если он создан исключительно для роботов и не несёт пользы для людей, или является аффилиатом другого ресурса, то его индексация может прекратиться. Покупая домены с неизвестной историей, вы очень сильно рискуете, поэтому лучше всего приобретать молодое, «чистое» доменное имя.

Помимо плохой кармы, на индексацию может повлиять наличие вредоносного кода. Он появляется после взлома сайта или при установке бесплатного шаблона. Следите за своим ресурсом через панель вебмастеров Яндекс и Google.

№3 Ошибки в коде.

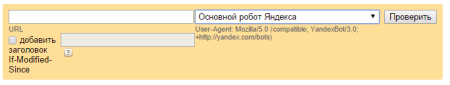

- Ответ сервера отличается от «200». Чтобы проверить, как ваш сервер отвечает роботам, используйте этот инструмент Яндекса: https://webmaster.yandex.ru/server-response.xml.

- Неправильный DOCTYPE. Проследите, чтобы код сайта отвечал html-стандартам и не имел ошибок.

- Редирект 302. Это временный редирект, с помощью которого старые страницы не изменяются на новые в индексе. Вместо него необходимо использовать 301-й, постоянный редирект.

- Неправильная кодировка. Убедитесь в том, что поисковики могут правильно прочитать кодировку. В противном случае, робот получит бессмысленный набор символов вместо русского текста и сочтёт его за низкопробный контент, не достойный индексации.

№4. Робот не может проиндексировать сайт.

Проверьте, все ли нужные страницы разрешены к индексации, есть ли к ним доступ. Он может оказаться закрытым разными способами. Вот наиболее частые причины.

- Мета-тег meta-robots может ограничивать доступ. На странице после тегав данном мета-теге может быть прописана запрещающая конструкция content=”nofollow,noindex”, из-за которой робот отказывается индексировать документ/сайт.

- Домен не делегирован. Убедитесь, что сайт действительно доступен посетителям. Помимо этого, проверьте, не снят ли домен с делегирования из-за размещения пиратского контента (например, фильмов или аудиотреков).

- Сайт закрыт в robots.txt. Случайно или нет, могут быть закрыты некоторые разделы/страницы, которые вы бы хотели проиндексировать. Например, запись “Disallow: /” может означать, что сайт полностью закрыт для роботов.

Проблемы с IP или User-Agent. В этом случае проблема в вашем хостере. Проверить, посещал ли сайт поисковый бот, можно с помощью анализа логов сервера (файл access.log). Обычно папка с логами (log) находится в корневой директории сайта. - X-ROBOTS-TAG. Проверьте, имеется ли этот метатег на ваших страницах. Это довольно редкий способ управления индексацией, однако стоит обратить на него внимание. X-ROBOTS-TAG работает на уровне заголовков сервера и влияет на содержимое различных типов. Вот так, например, можно скрыть от индексации картинки:

- Закрытие в тег noindex. Возможно, из-за заключения уникального контента в этот тег, роботу не хватает содержимого страницы для добавления её в выдачу.

№5 Другие проблемы с индексацией.

- Шаблонные тексты, сниппеты, заголовки, в которых меняется лишь пара слов;

- Внутренние дубли контента;

- Слишком глубокий уровень вложенности страниц (нужно выносить важные для индексации страницы на 2-3 уровень);

- Неуникальные тексты;

- Низкая скорость работы сайта из-за CMS или хостинга;

- Объём уникальных статей не превышает 500 знаков;

- Большое количество ошибок 404.

Проблемы индексации могут возникать и по другим причинам, не описанным здесь. Если вы не можете найти их самостоятельно, целесообразно обратиться к специалистам.

В остальном, чтобы страницы быстрее влетали в индекс, необходимо приучить робота, чтобы он заходил на сайт в одно и то же время. Для этого нужно с неизменной регулярностью и точностью публиковать контент и делать это чаще, чем 1-2 раза в месяц. Кроме того, не забывайте оставлять качественные ссылки на новые материалы как внутри проекта, так и за его пределами.

Пару сотен ссылок в твиттер в месяц и все будет ОК с индексацией, если контент не шляпа